Trí tuệ nhân tạo đang tái định hình toàn diện phương thức vận hành của doanh nghiệp hiện đại. Dù mang lại bước nhảy vọt về năng suất trong soạn thảo, phân tích hay tự động hóa, sự trỗi dậy của các mô hình ngôn ngữ lớn (LLM) lại vô tình phơi bày một bề mặt rủi ro bảo mật hoàn toàn mới. Trong bối cảnh các biện pháp kiểm tra SaaS truyền thống không còn đủ sức bảo vệ, việc thấu hiểu tường tận và kiểm soát chặt chẽ các thuộc tính của LLM không chỉ là một lợi thế, mà đã trở thành yêu cầu sống còn và bắt buộc đối với mọi Giám đốc An toàn Thông tin (CISO) ngày nay.

1. Tại sao các thuộc tính LLM lại quan trọng?

Hầu hết các sản phẩm AI SaaS đều nhúng các LLM của bên thứ ba, tạo ra cấu trúc “phụ thuộc kép”. Một ứng dụng có thể vượt qua mọi bài kiểm tra bảo mật, nhưng mô hình ẩn bên dưới nó vẫn có thể làm lộ dữ liệu, sinh ra mã lệnh (code) không an toàn hoặc làm rò rỉ các quy trình làm việc nhạy cảm của doanh nghiệp. Việc kiểm soát rõ ràng lớp LLM sẽ giúp thu hẹp lỗ hổng này và đưa công tác quản trị AI theo kịp các mối đe dọa hiện đại.

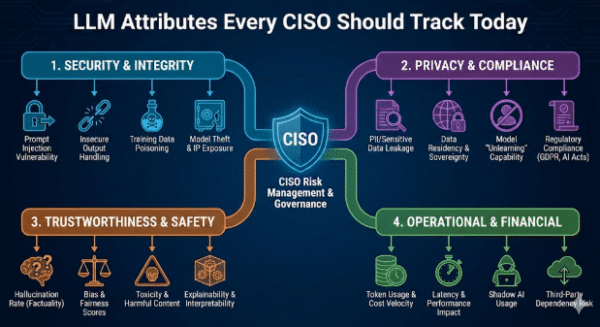

Các tính năng của LLM mà tất cả CISO cần theo dõi hiện nay

Các tính năng của LLM mà tất cả CISO cần theo dõi hiện nay

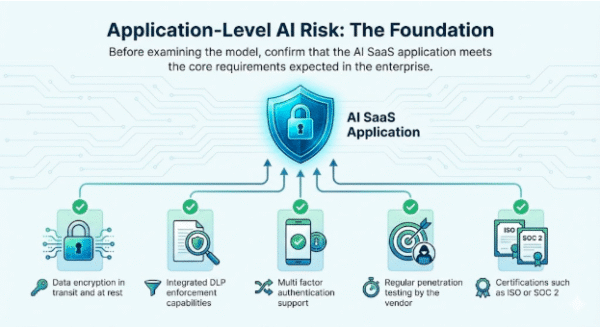

2. Rủi ro AI tại tầng ứng dụng: Nền móng bảo mật

Trước khi tập trung vào mô hình, cần xác nhận rằng ứng dụng AI SaaS đó đáp ứng được các yêu cầu an toàn cốt lõi trong doanh nghiệp. Các thuộc tính cơ sở cần xác minh bao gồm:

- Mã hóa dữ liệu khi truyền tải (in transit) và ở trạng thái nghỉ (at rest)

- Tích hợp khả năng thực thi các chính sách chống thất thoát dữ liệu (Data Loss Prevention – DLP)

- Hỗ trợ xác thực đa yếu tố (MFA)

- Nhà cung cấp thực hiện kiểm thử thâm nhập (Penetration testing) định kỳ

- Sở hữu các chứng nhận tuân thủ bảo mật như ISO hoặc SOC 2

Rủi ro AI tại tầng ứng dụng: Nền móng bảo mật

3. Hành vi của LLM: Nguồn gốc của bề mặt rủi ro mới

Thuộc tính LLM ảnh hưởng trực tiếp đến cách ứng dụng phản hồi lại người dùng thực và các câu lệnh đánh lừa (adversarial prompts). Các CISO hiện cần phải theo dõi các hành vi sau trên mọi mô hình được nhúng:

- Tích hợp GenAI và LLM: Cần xác định chính xác tên mô hình, khu vực lưu trữ (hosting region), chu kỳ cập nhật và liệu nhà cung cấp có tiến hành tinh chỉnh (fine-tune) mô hình bằng dữ liệu của khách hàng hay không?

- Rủi ro Tấn công bẻ khoá ((Jailbreak Exposure): Xảy ra khi người dùng thao túng câu lệnh (prompt) để lách qua các chốt kiểm soát an toàn của LLM bằng các kỹ thuật như nhập vai (role-playing), đưa ra chỉ thị đa lớp, tạo bối cảnh giả tưởng hoặc dùng ngôn ngữ mã hóa

Ví dụ: một kẻ tấn công có thể lừa chatbot cung cấp hướng dẫn vô hiệu hóa tính năng xác thực MFA trên tài khoản của khách hàng

- Tạo mã độc và phần mềm độc hại (Malware): LLM đôi khi sinh ra các đoạn mã có chứa các đường dẫn thực thi ẩn hoặc các thói quen đánh cắp dữ liệu (exfiltration routines) mà bề ngoài vẫn có vẻ hợp lệ về mặt logic

- Rủi ro về đầu ra độc hại (Toxicity), thiên vị (Bias) và CBRN: Các mô hình có thể tạo ra văn bản không an toàn hoặc mang tính phân biệt đối xử khi bị nhồi nhét các prompt nhạy cảm hoặc thù địch

Ví dụ, LLM dùng để tuyển dụng có thể hạ điểm đánh giá ứng viên dựa trên các dấu hiệu về giới tính (gây rủi ro Bias), hoặc khả năng mô hình cung cấp hướng dẫn từng bước về hóa chất, sinh học, phóng xạ hoặc hạt nhân nguy hiểm (rủi ro CBRN).

Đọc thêm: Top 10 mối đe doạ LLM

4. Tuân thủ hướng dẫn LLM của NIST và OWASP

Khung hồ sơ AI tạo sinh của NIST đang trở thành tiêu chuẩn cốt lõi để quản lý rủi ro AI có trách nhiệm. Đồng thời, danh sách OWASP Top 10 cho ứng dụng LLM cũng chỉ ra những lỗ hổng hoàn toàn mới như chèn câu lệnh độc hại, xử lý đầu ra không an toàn (insecure output handling) và đầu độc dữ liệu huấn luyện (training data poisoning). Việc không tuân thủ các hướng dẫn này làm tăng nguy cơ kiểm toán thất bại, đặc biệt ở các lĩnh vực như tài chính hay y tế.

5. Các bước hành động khuyến nghị cho CISO

Một chương trình quản trị AI hiện đại phải kết hợp được việc kiểm tra ứng dụng với các chốt kiểm soát nhạy bén ở cấp độ mô hình. Dưới đây là 5 bước khuyến nghị:

- Xây dựng danh mục toàn diện các ứng dụng AI và LLM: Cần bao quát cả các công cụ được phê duyệt, AI ngầm (shadow AI) và các tải công việc AI nội bộ

- Chấm điểm rủi ro từng mô hình: Đánh giá khả năng chống jailbreak, hành vi tạo malware, nguồn gốc dữ liệu huấn luyện và khả năng tuân thủ để thiết lập các ranh giới sử dụng an toàn

- Bảo vệ dữ liệu nâng cao ở lớp prompt: Ứng dụng công nghệ tạo dấu vân tay số (fingerprinting) và DLP nâng cao để chặn lại nội dung nhạy cảm ngay cả khi văn bản trong prompt trông có vẻ vô hại

- Kiểm thử mô hình liên tục (Continuous Model Testing): Tự động hóa các bài kiểm tra tấn công chèn câu lệnh (prompt injection) và đánh giá mô phỏng tấn công (adversarial evaluations) ở mỗi vòng cập nhật mô hình, thay vì chỉ đánh giá rủi ro nhà cung cấp một lần duy nhất

- Mở rộng chương trình quản lý rủi ro nhà cung cấp: Đưa tính minh bạch của LLM (cách chọn mô hình, thực tiễn huấn luyện và cách lưu giữ prompt) thành những điều khoản bắt buộc trong hợp đồng để đưa chuỗi cung ứng AI vào cùng một cấu trúc quản trị với môi trường SaaS

Kết luận

Trong thời đại hiện nay, bảo mật ứng dụng đòi hỏi một chiến lược hai lớp. Ở lớp ứng dụng, doanh nghiệp kiểm soát truy cập và dữ liệu. Ở lớp mô hình, cần đánh giá hành vi và cách xử lý dữ liệu của LLM. Việc hiểu rõ tính năng của LLM giúp doanh nghiệp triển khai AI an toàn. Đồng thời, đảm bảo tuân thủ và giảm thiểu rủi ro trong dài hạn.

Liên hệ Mi2 ngay hôm nay để kiểm soát các thuộc tính của LLM, từ đó kiến tạo chiến lược bảo mật AI hiệu quả và an toàn dài hạn!