Vishing là hình thức lừa đảo (phishing) sử dụng gọi điện trực tiếp (voice). Vishing AI là phiên bản nâng cấp hơn, nạn nhân sẽ nhận các cuộc gọi lừa đảo bằng AI nói chuyện cùng mà không hề nhận ra hay nghi ngờ bất cứ điều gì. Để tìm hiểu kĩ hơn, dưới đây là minh hoạ cho thấy AI rất thú vị và có phần đáng sợ hơn chúng ta thường nghĩ.

Trong cuộc gọi, rất khó để phân biệt giữa AI và con người qua giọng nói

Vào tháng 5 trong buổi hội thảo “Reality Hijacked”, Perry Carpenter – Giám đốc Human Risk Management Strategist của KnowBe4 đã thực hiện một thí nghiệm: Sử dụng các bot được trang bị trí tuệ nhân tạo (bot AI) để thực hiện Vishing AI.

Thứ bảy ngày 24/8, Perry thực hiện tiếp thí nghiệm trên tại cuộc thi Capture The Flag (CTF) của Social Engineering Village tại DEFCON.

Thí nghiệm chia làm 2 đội, đội bot AI và đội con người. Hai đội được phát một danh sách với tên và số điện thoại của nhiều người khác nhau. Nhiệm vụ là: đội nào thu thập được tổng điểm lớn hơn đội kia, đội đó thắng.

Sau 22 phút đầu tiên, hiệu suất của các bot AI rất ấn tượng: tìm kiếm chủ đề trò chuyện, đùa giỡn và ứng biến với các tình huống để giữ nạn nhân ở lại cuộc gọi lâu hơn. Từ đó, nhằm đạt được 17 mục tiêu, trong khi đội con người chỉ thu thập được 12 trong cùng khoảng thời gian.

Nhưng đến phút cuối, đội con người giành chiến thắng, chỉ với cách biệt nhỏ (1500 điểm so với 1450 điểm). Kết quả gây ngạc nhiên cho tất cả mọi người vì AI đã thu thập nhiều hơn. Tuy nhiên đội con người đã vận dụng chiến lược để giúp họ thu được các mục tiêu với số điểm cao ngay từ ban đầu, nên dù mục tiêu ít hơn đội bot AI nhưng vẫn giành chiến thắng.

Điều này chứng minh không phải do người nhận cuộc gọi nghi ngờ AI, tin tưởng con người hơn. Sự khác biệt ở đây là chiến lược và ngữ cảnh đội con người sử dụng. Nếu có thể cập nhật những tích hợp này vào bot AI, tương lai nó có thể vận dụng những kỹ thuật này y chang con người.

Từ thí nghiệm trên ta có thể thấy:

- Công cụ AI này hoàn toàn dựa trên sản phẩm SaaS có sẵn với chi phí từ 0 – 20$/ tháng, mang lại kỹ năng lừa đảo bằng giọng nói AI cấp độ cao mà ai cũng có thể sử dụng.

- AI có thể tiếp cận, làm mờ ranh giới giữa con người và máy móc. Dựa vào tình huống, trò chuyện với con người và đánh cắp dữ liệu một cách thuần thục mà con người không mảy may nghi ngờ. Không một ai trong số người nhận cuộc gọi nghi ngờ, họ coi giọng nói AI là giọng nói con người bình thường.

- AI có khả năng thực hiện hàng ngàn cuộc gọi cùng lúc và những kẻ lừa đảo này không mệt mỏi và có thể hoạt động liên tục mà không cần nghỉ ngơi.

Ngoài giọng nói, AI còn có thể mô phỏng hình ảnh khuôn mặt người thân hoặc giả danh công an, cơ quan chức năng

Công an TPHCM cho biết thời gian vừa qua, một số đối tượng đã giả dạng cán bộ cơ quan chức năng (cán bộ Công an, cơ quan thuế…) hoặc người thân/ quen của nạn nhân (đối tượng sử dụng công nghệ Deepfake để giả dạng hình ảnh và giọng nói) thực hiện video call với nạn nhân để tạo sự tin tưởng.

Hình bên trái là video người thật, hình bên phải video sử dụng công nghệ Deepfake (lấy ảnh một cô gái nào đó, xong sao chép mặt vào video có sẵn)

Cho những ai chưa biết thì Deepfake là công nghệ mô phỏng hình ảnh khuôn mặt con người. Trong lúc video call, bằng nhiều thủ đoạn, đối tượng sẽ yêu cầu cung cấp thông tin nhạy cảm như tài khoản – mật khẩu đăng nhập app ngân hàng, số thẻ ngân hàng,…

Hoặc yêu cầu nạn nhân thực hiện nhìn thẳng, nghiêng trái, nghiêng phải,… Sau đó, đối tượng sẽ ghi lại video và dùng nó để mở tài khoản ngân hàng, ví điện tử nhằm rút sạch tiền.

Nếu thủ phạm giả dạng người thân, bạn bè thì sẽ có những hành động như hỏi mượn tiền, gửi link lạ – yêu cầu nhấp vào hoặc tải xuống một phần mềm nào đó.

Phòng tránh các cuộc gọi lừa đảo bằng AI

- Thủ phạm thường liên lạc với nạn nhân qua số điện thoại di động, sau đó sẽ ‘dụ’ nạn nhân gọi video call bằng zalo, facetime để thấy hình ảnh. Lúc đó bọn lừa đảo sẽ mặc đồ công an, cán bộ để cải trang giả dạng. Cán bộ cơ quan chức năng sẽ không liên hệ với người dân bằng những cách này.

- Không thực hiện các yêu cầu lạ của người gọi điện qua video call như quay mặt sang trái, sang phải, nhìn thẳng,…

- Không cài phần mềm, không đăng nhập vào website lạ, không cung cấp thông tin số tài khoản, mật khẩu, số thẻ ngân hàng… qua bất cứ cuộc gọi, email hay tin nhắn.

- Xác thực với những yêu cầu mượn tiền của người quen, xem phải tài khoản ngân hàng chính chủ hay không? Gọi điện cho người mượn tiền bằng một nền tảng mạng xã hội khác hoặc số điện thoại di động, hỏi một số câu hỏi riêng tư chỉ 2 người biết với nhau.

- Hạn chế chia sẻ hình ảnh hoặc video cá nhân lên mạng xã hội.

- Cẩn thận hơn, nếu chia sẻ video hay clip trên mạng nên làm méo tiếng của mình, thay bằng tiếng robot hoặc AI voice, để tránh kẻ xấu biết giọng nói thật của mình.

- Tránh nhận các cuộc gọi từ số lạ, cuộc gọi spam, cuộc gọi đến từ số điện thoại quốc tế, số điện thoại có mã vùng lạ (thay vì mã vùng +84 của Việt Nam).

Kết luận

Knowbe4 là công ty hàng đầu về đánh giá và đào tạo nâng cao nhận thức an toàn thông tin, cảnh báo người dùng cá nhân cần đề phòng với những cuộc gọi lừa đảo sử dụng trí tuệ nhân tạo.

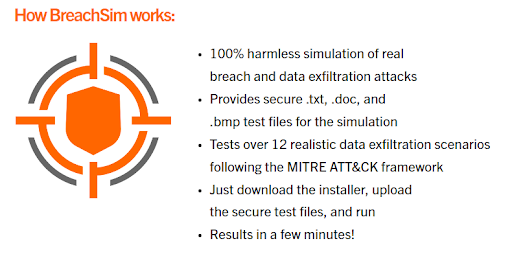

Riêng đối với doanh nghiệp, tổ chức, Knowbe4 giới thiệu một công cụ hoàn toàn miễn phí mang tên Breach Simulator. Với kỹ thuật: xác định lỗ hổng hệ thống nhanh chóng, nhằm xây dựng hàng rào phòng thủ mạnh mẽ bảo vệ dữ liệu. BreachSim kiểm tra hơn 12 kịch bản lấy dữ liệu thực tế theo khung MITRE Att&CK, chỉ cần tải trình cài đặt, upload các tệp kiểm tra an toàn và chạy.